Data Scientists halten keine Neujahrsansprachen und Jahresrückblicke. Zu rasant ist die Entwicklung von Spark, KI und Co., als dass wir uns eine Ruhepause gönnen könnten, um einen Moment innezuhalten. Zu rational vielleicht auch die Profession für Gefühlsduselei und rückschauende Sentimentalität. Müsste ich in diesen Tagen jedoch etwas Pathetisches schreiben, ich würde es der logistischen Regression widmen!

Sie ist unser Arbeitspferd und Fixstern. Grundbaustein und gemeinsamer Nenner. Paradebeispiel und sicherer Hafen. Könnte ich drei Modelle auf eine einsame Insel mitnehmen: Eines wäre zweifelsohne die logistische Regression.

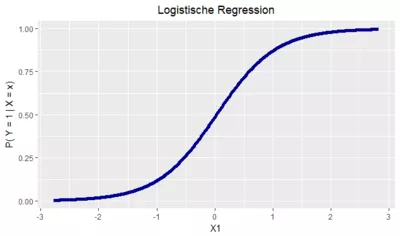

Hier strahlt sie in ihrer ganzen Schönheit:

Die logistische Regression als Arbeitspferd

Die logistische Regression ist Arbeitspferd, weil sie verlässlich ihre Arbeit leistet, ohne dabei für viel Aufregung zu sorgen. Im Scheinwerferlicht stehen die Rockstars unserer Zunft, wie rekurrente neuronale Netze oder Gradient Boosted Trees. Sie gewinnen die Data-Science-Wettbewerbe, lösen neue (KI-)Revolutionen aus und bedrohen, laut Elon Musk, sogar unsere Zivilisation. In den Maschinenräumen der Industrie läuft häufig jedoch, stillschweigend und beflissen, die logistische Regression. Und das aus guten Gründen:

Schnelles Prototyping:

Die Frequenz der Entwicklungszyklen in (agilen) Data-Science-Projekten steigt. Häufig werden erst sukzessive neue Datenquellen erschlossen und interpretiert. Die logistische Regression kann durch ihre geringe Berechnungskomplexität den Modellierungsprozess wesentlich verkürzen. Zudem dienen die Modellierungsergebnisse als Grundlage und Benchmark für die Entwicklung komplexerer Modelle. Die Gefahr, am Ende des Projekts mit leeren Händen dazustehen, sinkt.

Fokus auf Feature Engineering und Data Understanding:

Neuronale Netze und Entscheidungsbäume sind verführerisch, denn sie erledigen das Feature Engineering gleich mit. Der geneigte Data Scientist überlässt die Arbeit dem Lernalgorithmus und lehnt sich zurück. Doch auch hier ist Gefahr im Verzug: Data Science ist Erkenntnisgewinn aus Daten. Dies bedarf der Auseinandersetzung mit Daten, im wahrsten Sinne des Wortes. Die logistische Regression zwingt zur Sorgfalt und führt erfahrungsgemäß zu lukrativen Einsichten in datengenerierende Prozesse, Modellvalidität und Wirkungszusammenhänge.

Interpretierbarkeit und Kommunikation:

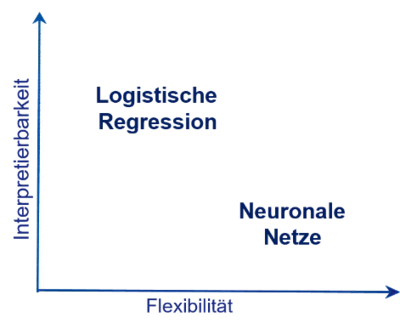

Das maschinelle Lernen von funktionalen Zusammenhängen bewegt sich häufig im Spannungsfeld von Vorhersagbarkeit und Interpretierbarkeit. Flexiblere Modelle erhöhen in der Regel die Prognosegüte, reduzieren jedoch auch die Interpretierbarkeit der Ergebnisse. Häufig interessieren sich die Stakeholder jedoch gerade für „actionable insights“, also diejenigen Erkenntnisse, die sich konkret in Handlungsanweisungen ummünzen lassen. Die logistische Regression knüpft hier an: Ihre Interpretation über Eintrittswahrscheinlichkeiten erlaubt leicht verständliche Einblicke in das Beziehungsgeflecht beteiligter Variablen.

Kommunikation ist wesentlicher Bestandteil jedes Data-Science-Projekts. Komplexe Modelle werden häufig als Black Box wahrgenommen und stoßen dann auf wenig Vertrauen. Die Interpretierbarkeit der logistischen Regression dient also der Akzeptanz von Projektergebnissen.

Grundbaustein für Advanced Analytics oder „Wer fliegen will, muss erst lernen zu laufen“

Der Einsatz der logistischen Regression empfiehlt sich gerade beim Aufbau neuer Data-Science-Abteilungen und in deren Weiterbildung. Viele Konzepte können anschaulich und nicht-trivial anhand ihrer Modellmechanik erklärt werden, wie z. B. Gradient Descent, Maximum Likelihood Estimation oder Regularisierung. Vielfach, und oft überraschend, wird sie als Einführung in das maschinelle Lernen verwendet. Mit ihrem geschlossenen Interferenzkonzept lässt sich zusätzlich eine Brücke in die klassische Statistik schlagen.

Logistische Regression und AI

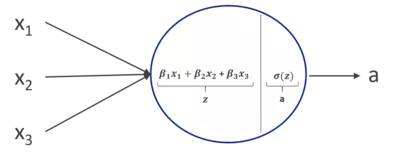

Vielfältigkeit und didaktisches Können zeigt die logistische Regression ganz aktuell in der Entwicklung von neuronalen Netzen. Konzeptionell können tiefe neuronale Netze als hintereinandergeschaltete logistische Regressionen verstanden werden. An sich ist die logistische Regression bereits ein klitzekleines neuronales Netz, was der folgende Computergraph veranschaulicht:

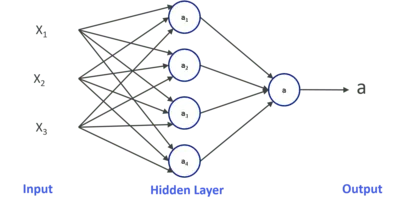

Schalten wir nun eine Vielzahl dieser „Neuronen“ hintereinander und lassen ihren Output als Input weiterer Neuronen agieren, erhalten wir die grundlegende Struktur eines neuronalen Netzes:

Im Kontext von neuronalen Netzen übernimmt die logistische Regression, aka Sigmoid-Funktion, die Rolle einer Aktivierungsfunktion. Die Speerspitze der Aktivierungsfunktionen haben auch hier wieder andere übernommen, aber es ist und bleibt beeindruckend: Hat man die Funktionsweise der logistischen Regression erst verstanden, kann man sich rasch ein Bild von neuronalen Netzen machen.

Die logistische Regression als Fixstern

Wer sich in den Hype-Zyklen rund um Data Science, Artificial Intelligence oder Machine Learning zurechtfinden will, ist gut beraten, sich an der logistischen Regression zu orientieren. Trends kommen und gehen, die logistische Regression bleibt. Seit über fünfzig Jahren strahlt sie am Data-Science-Himmel und leuchtet uns den Weg. Dieser Text ist für sie.

In diesem Sinne wünscht das Data-Science-Team von b.telligent ein frohes und spannendes Jahr 2018!